10秒看完全文要点

10秒看完全文要点

来源:华泰睿思

存储周期持续上行,关注国内产业链投资机遇

自9月以来,闪迪、美光、三星等海外存储原厂相继宣布涨价,且涨价幅度多超市场预期。DRAM方面,AI驱动的HBM及高容量DDR5需求仍保持旺盛,推动4Q25主流DRAM价格继续稳健上行,且美光FY25Q4业绩会上表示26年DRAM市场供需关系仍将保持紧张;NAND方面,除原厂严格控制产能稼动率外,HDD供应短缺叠加AI推理应用快速增加进一步加大企业级SSD需求,推动NAND供需结构持续优化,4Q25价格涨幅或较3Q25有所扩大。供需共振推动存储周期向上,国内存储产业链相关公司详见研报。

核心观点

闪迪、美光等陆续宣布涨价,4Q24 DRAM/NAND价格延续涨势

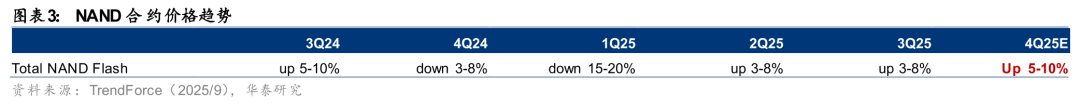

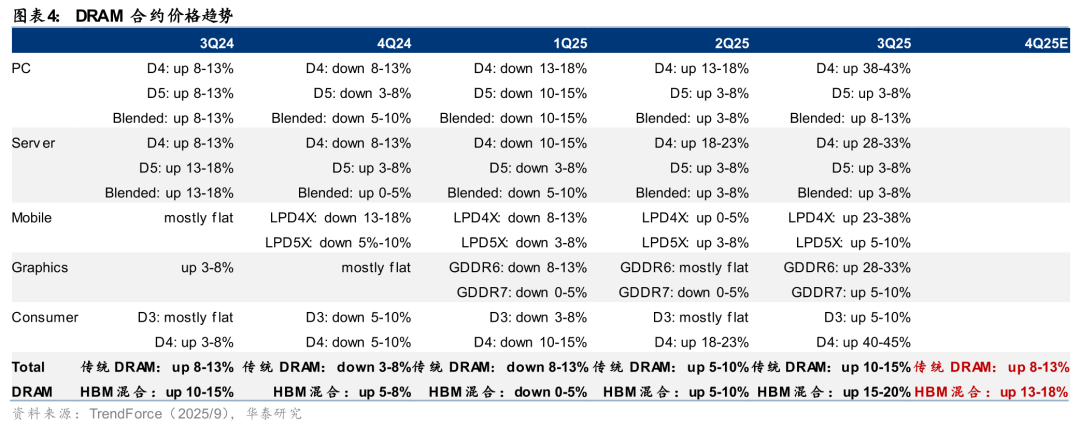

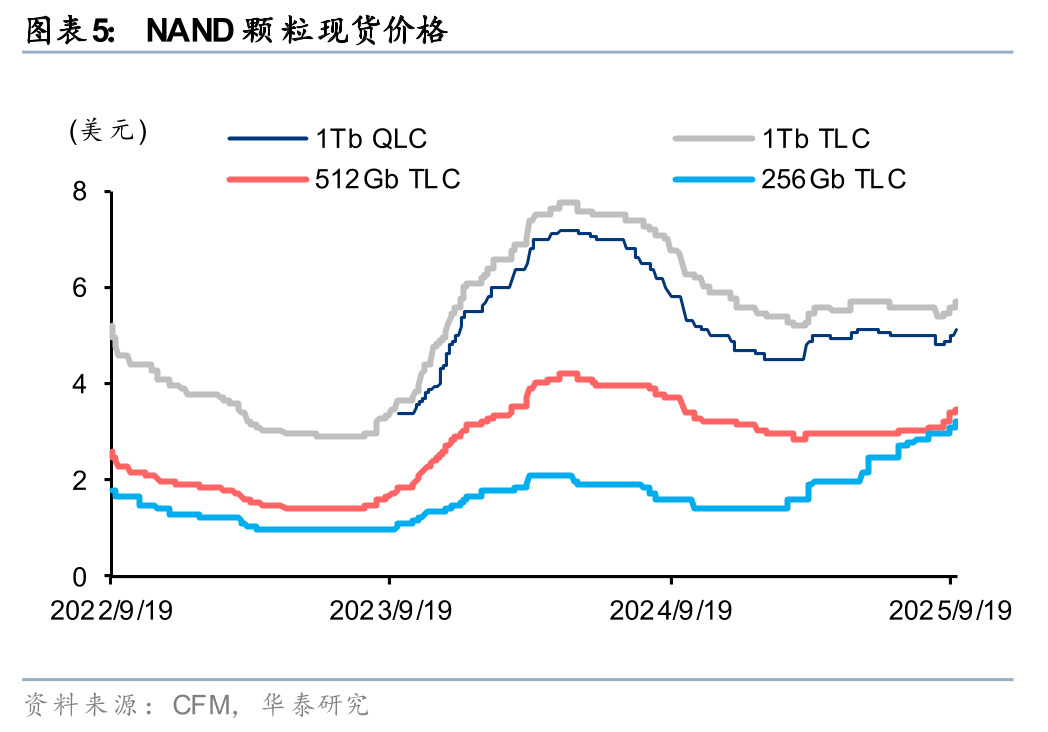

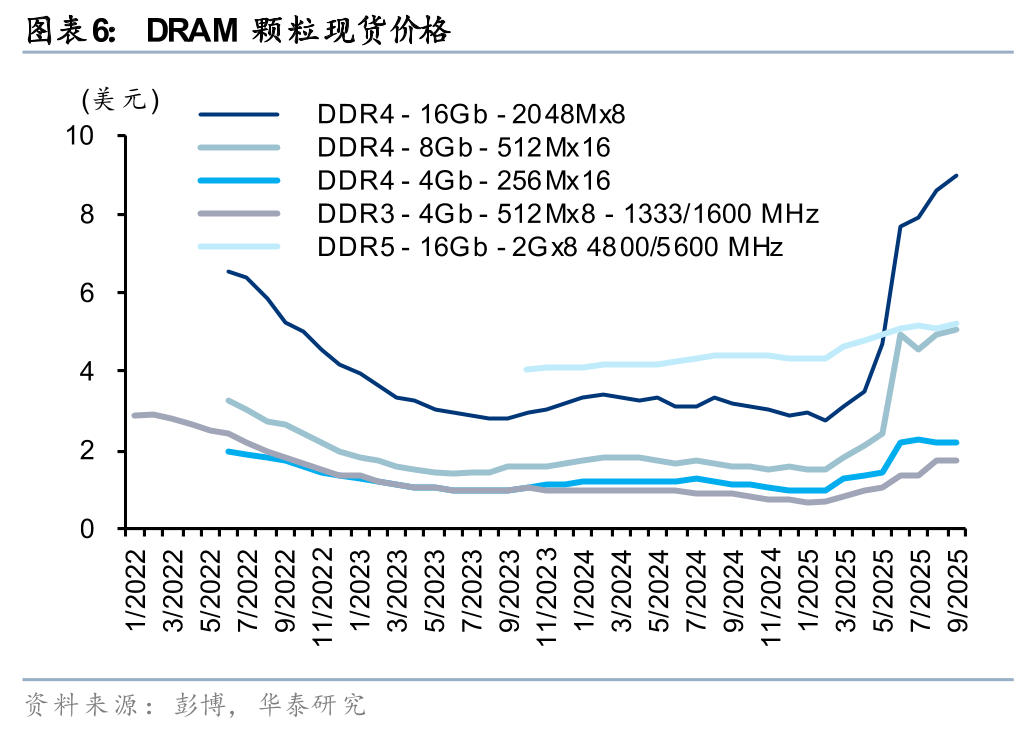

9月初,闪迪率先发布涨价函,面向渠道和消费者客户的新报价及订单涨价超10%,反映人工智能应用以及数据中心、客户端和移动领域日益增长的存储需求;随后美光、三星电子亦陆续宣布涨价,奠定4Q25存储价格持续上涨趋势。同时,我们观察到美光指引下季度(9月-11月)Non-GAAP毛利率50.5-52.5%,大超彭博一致预期的46.1%,亦反映持续改善的存储价格环境。此前,由于智能手机、PC等消费电子需求复苏较为缓和,市场预期4Q25 DRAM、NAND价格涨幅环比均将收敛。但据TrendForce(9月)最新预估,4Q25 DRAM整体价格将环比增长13%~18%;NAND Flash平均涨幅将达5%~10%(3Q25:3%-8%),涨价幅度或较3Q有所扩大。

HDD供应紧缺叠加推理需求增长,推动企业级SSD应用加速渗透

据TrendForce报道,西部数据及希捷等全球主要HDD供应商因近年未规划扩大产能,致使Nearline HDD(近线硬盘)已出现供应短缺,交期达52周,从而进一步加速北美CSP厂商对高效能的企业级SSD应用。同时,AI大模型推理应用呈快速增长态势,持续提升的上下文长度以及对话轮次使得KV Cache容量快速提升,逐渐成为大模型推理效率及效果提升的主要矛盾。我们测算,在LLaMA-2-13B模型推理中,仅考虑单个请求token数为4096且并发请求数10个,则以FP16精度进行缓存时,对应所需KV Cache容量便达31GB,随请求轮次增加及并发请求数提升均将使其呈倍数级快速提升。铠侠、美光等致力将部分KV Cache从HBM、DRAM卸载至SSD,形成多级缓存结构,将显著带动NAND需求增长。

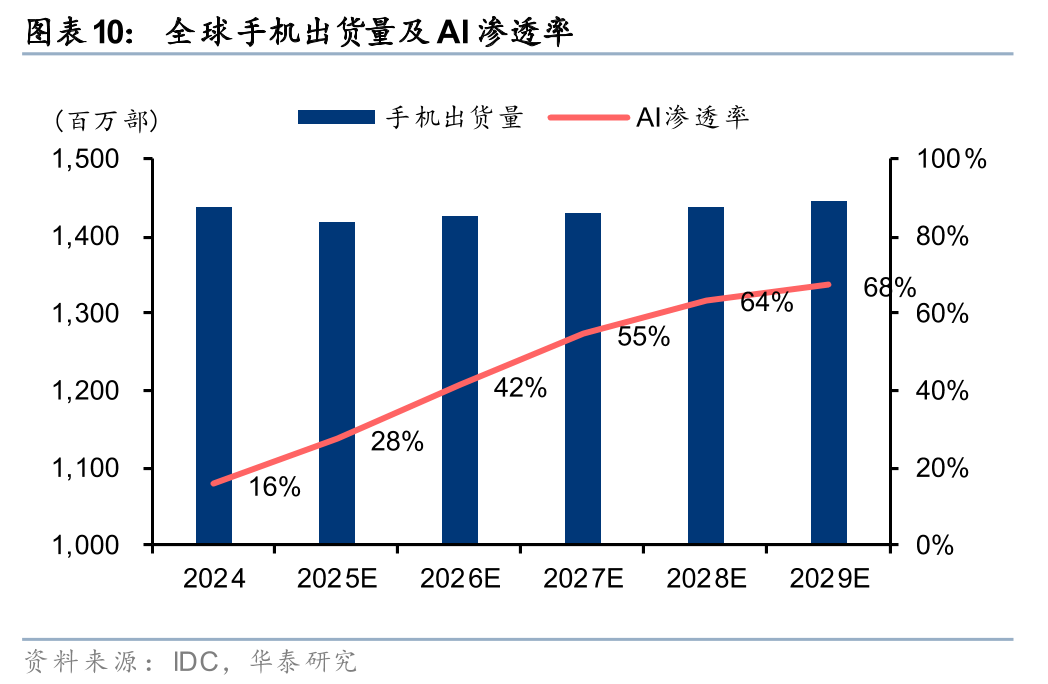

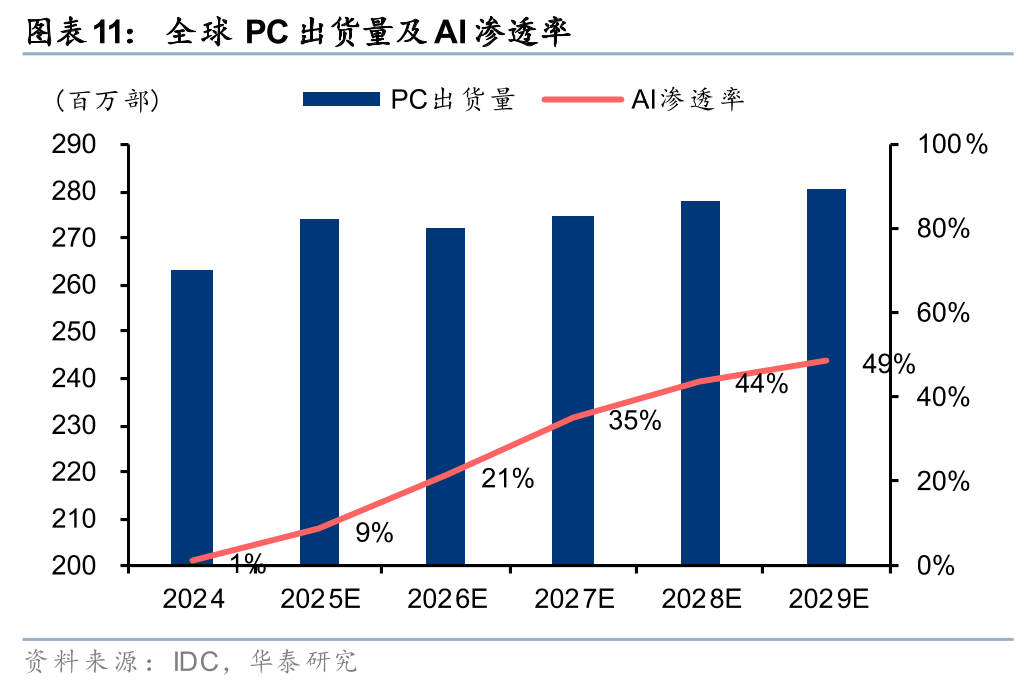

手机/PC AI升级拉动单机容量配置,AI眼镜带来新增市场需求

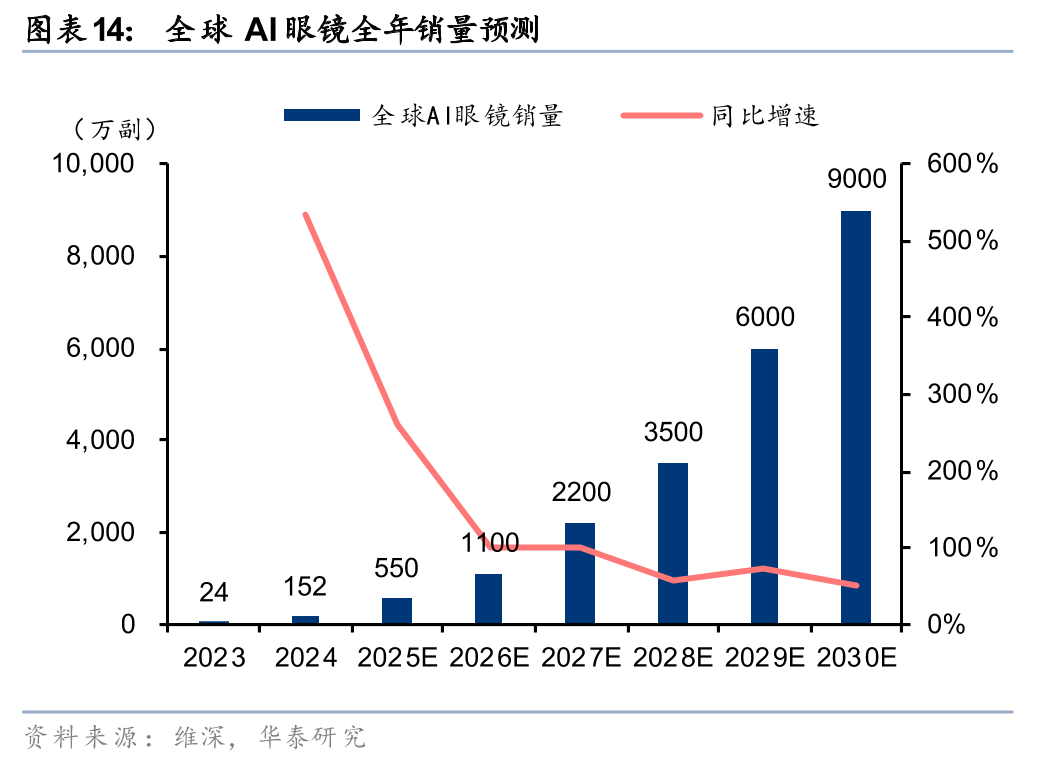

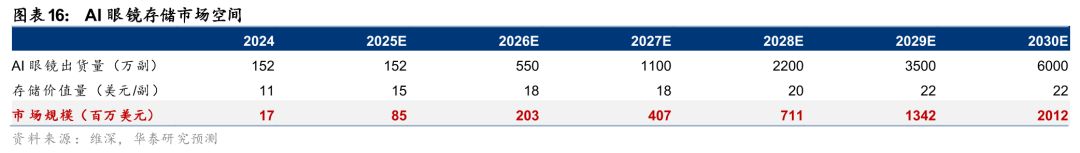

手机/PC AI升级带来的单机存储容量提升成为端侧存储需求增长的主要驱动力。以苹果手机为例,其最新发布的iPhone 17全系列已取消128GB闪存配置,以256GB起步,且Pro Max机型首次提供高达2TB选项,高端机型闪存已基本进入512GB以及TB时代。此外,以AI眼镜为代表的AI新兴终端需求快速增长,带来新增存储市场需求。根据维深数据,2030年全球AI眼镜出货量将达到9000万副,考虑AI眼镜AI处理能力不断升级,未来存储容量亦将进一步增加,我们预计2030年AI眼镜存储市场规模将超20亿美金。国内存储模组厂商在该领域布局领先,有望充分受益。

风险提示:下游需求复苏不及预期风险;国产存储供应链技术进展不及预期风险;地缘政治风险;宏观经济波动风险。本研报中涉及到的未上市公司或未覆盖个股内容,均系对其客观公开信息的整理,不代表本研究团队对该公司、该股票的推荐或覆盖。

正文

存储:供需共振,推动周期持续上行

供给:海外原厂严控NAND产能,HDD供应出现短缺

海外原厂严控NAND产能,推动供需关系改善。2024年底以来,美光、三星、SK海力士、西部数据等海外大厂纷纷宣布将积极减产NAND,推动市场供需平衡持续优化。且往后看,海外存储原厂CAPEX投入仍将主要聚焦HBM及高容量DDR5产能建设,NAND产能扩张保持相对谨慎。根据IDC数据,2025年全球NAND位元供应量同比增加15%,预计2026年增速为16%,整体保持相当水平。

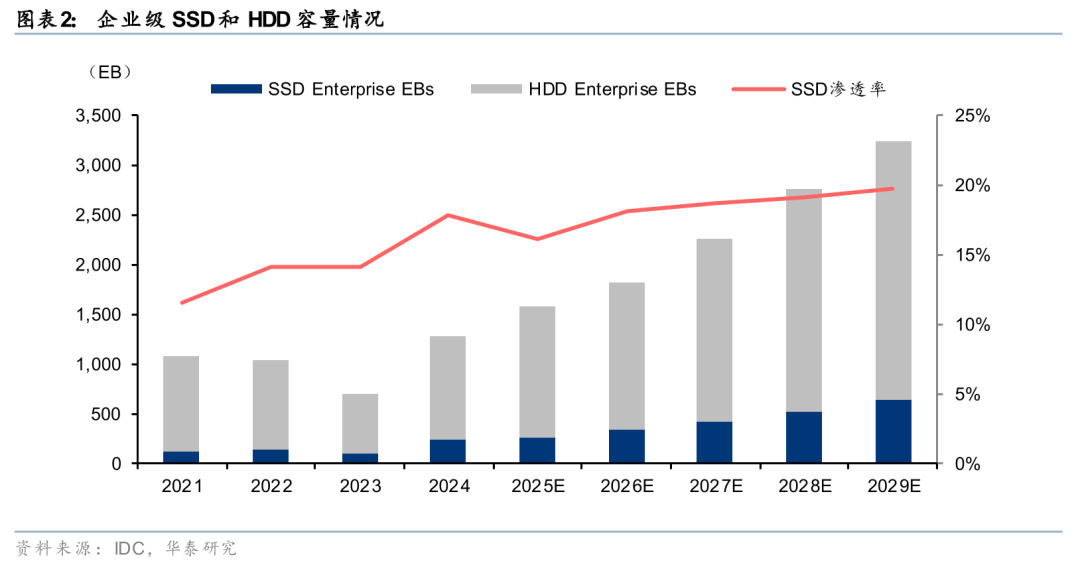

HDD数据中心存储占比达80%,供应短缺将加速SSD渗透。AI带来数据中心海量数据存储需求,其中,机械硬盘(HDD)承担数据中心超80%存储容量需求。据TrendForce(9月) 报道,因西部数据及希捷等全球主要HDD供应商近年未规划扩大产能,致使Nearline HDD(近线硬盘)已出现供应短缺,交期达52周,从而进一步加速北美CSP厂商对高效能、高成本的企业级SSD应用。

价格:4Q25 DRAM/NAND价格继续上行,NAND涨幅环比扩大

海外存储原厂陆续发布涨价函,4Q25 DRAM/NAND价格继续上行。9月初,闪迪率先发布涨价函,面向渠道和消费者客户的新报价及订单涨价超10%,反映人工智能应用以及数据中心、客户端和移动领域日益增长的存储需求;随后美光通知客户,包括DDR4、DDR5、LPDDR4、LPDDR5等内存产品全部停止报价,且相关产品价格可能调涨20%-30%;9月下旬,三星电子亦宣布第四季度将涨价,其中,LPDDR4X、LPDDR5/5X等DRAM产品预计上涨15%-30%,eMMC/UFS预计上涨5%-10%。伴随各大原厂陆续发布涨价函,奠定4Q25存储价格持续上涨趋势。

据TrendForce(9月)最新预估,4Q25 DRAM整体合约价格将环比增长13%~18%,其中,DDR4/LPDDR4虽面临原厂延长供应时间影响,但由于原厂及下游整体库存水位均较低且客户端DDR5/LPDDR5升级仍需一定时间周期,我们预计4Q25价格环比亦将继续上行;此外,NAND Flash平均合约价格涨幅将达5%~10%(3Q25:3%-8%),超此前市场认为4Q25涨幅环比将收敛的预期。

需求:数据中心需求旺盛,端侧依赖AI升级拉动

数据中心:企业级存储需求旺盛,推理应用快速增长或将进一步拉动NAND需求

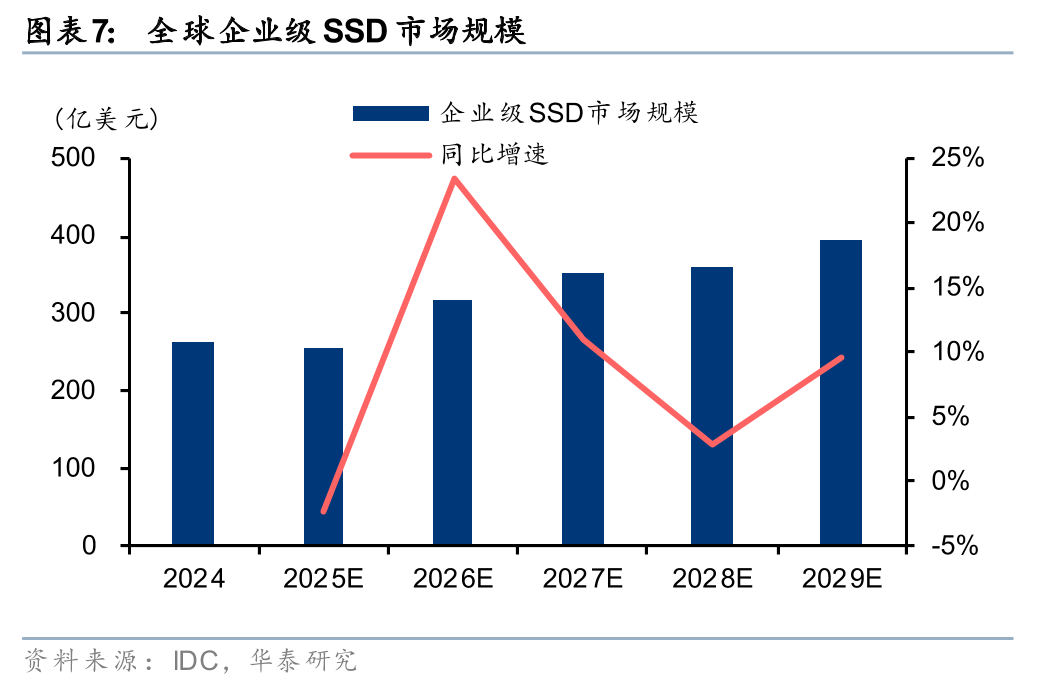

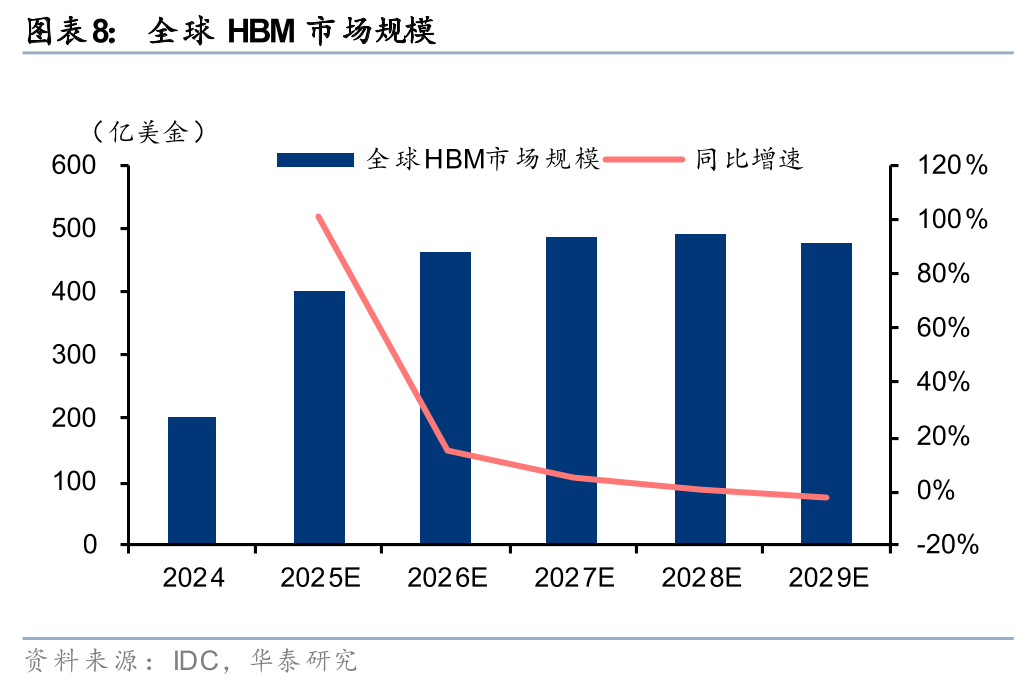

2024年企业级SSD及HBM市场规模分别为262/200亿美金,2025-2027年CAGR达10/35%。自2022年11月ChatGPT发布以来,生成式AI进入快速发展阶段。AI大模型持续迭代驱动云端AI算力需求快速增长,海内外主要云厂商持续加大数据中心资本开支投入。AI大模型训练及推理对高速存储需求显著提升,既需要高容量DDR5及HBM存储巨量参数和中间计算数据,又需要企业级SSD存储大量数据集(LLM训练语料、图片、视频等)。2024年,AI数据中心建设驱动下,全球企业级SSD需求旺盛,SK海力士、铠侠企业级SSD全年收入增长超300%。据IDC数据,2024年全球企业级SSD/HBM市场规模为262.2/200亿美金,预计2027年将增长至351/488亿美金,对应年复合增速10.2/34.6%。

AI推理快速增长,有望进一步拉动NAND需求。目前,微软、谷歌等头部厂商日均token调用量均已突破万亿级别,AI大模型推理应用正加速落地。在AI推理中,以往SSD主要应用于存储RAG和LLM参考的相关文档和知识库。此外,需要在HBM或DRAM中加载模型权重,以及持续缓存注意力计算的中间状态(KV Cache)。

KV Cache容量主要受模型Transformer层数、注意力头(head)、注意力头维度、单个请求最大token数、数据精度以及并发请求数等因素影响。以LLaMA-2-13B模型为例,若单个请求token数达4096,并发请求数10个,且以FP16精度进行缓存,则对应所需KV Cache容量达31.25GB。伴随AI推理中处理的上下文长度持续加长以及对话轮次进一步增长,KV Cache容量将快速提升,逐渐成为大模型推理效率及效果提升的主要矛盾。

铠侠、美光等均积极推进AI SSD产品的研发和推出,致力于将KV Cache从更高成本的HBM、DRAM中部分卸载至大容量、高性价比SSD。8/28,华为举行数据存储AI SSD新品发布会,通过AI SSD产品构造HBM+DRAM+SSD三级缓存体系,其中在SSD层通过存算一体技术,将AI 推理的中间结果(如长序列对话历史)持久化存储,形成PB级KV Cache池,带来AI推理效率和时延表现提升。

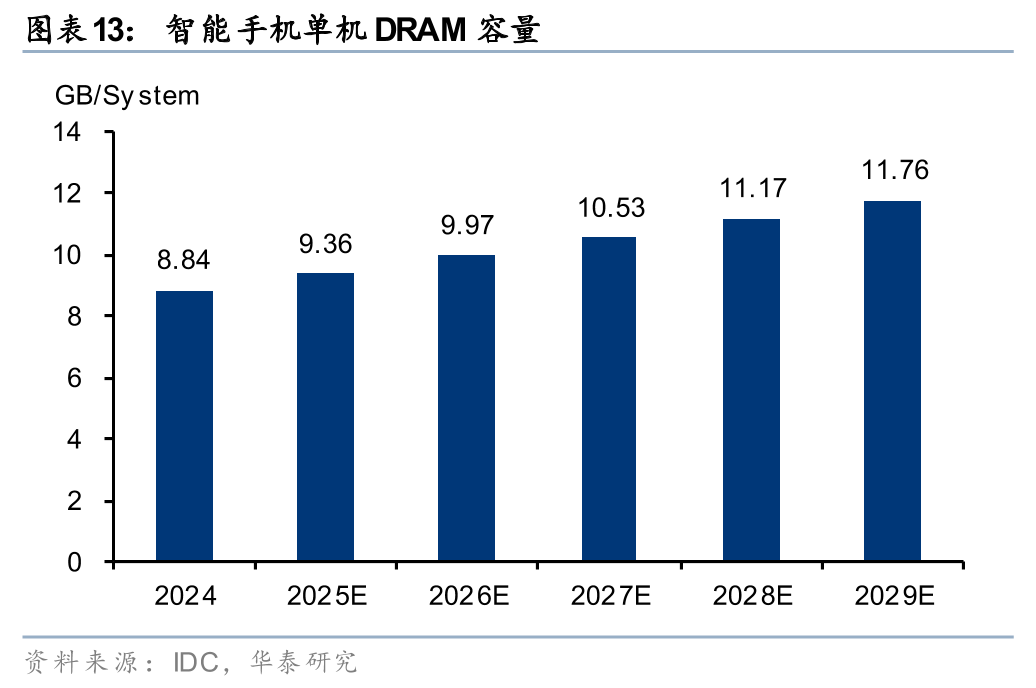

手机/PC:AI升级拉动单机存储容量提升

AI手机对内存升级提出明确需求,本地模型参数增长对闪存配置也有所拉动。当前旗舰手机中12/16GB LPDDR5X已成为主流配置,闪存配置也基本从256GB UFS4.0起步。目前主流安卓旗舰机型大多已实现70亿LLM的本地部署,根据Counterpoint数据,本地大模型参数的上限将在2024年增长至130亿,2025年有望达到170亿。根据联发科预计,130 亿参数AI大模型运行约需13GB内存(INT8精度),若加上6GB APP保活和4GB安卓OS,合计手机内存容量总需求将达到23GB。此外,AI手机对于闪存的容量/性能要求也会随着本地部署模型的参数量增长而有所提升,但短期来看AI手机对闪存升级的迫切性排序仍在内存之后。但我们也观察到UFS在智能手机市场的市占率持续提升,UFS 4.0 增长更为显著。容量方面,高端机型基本进入512GB以及TB时代。

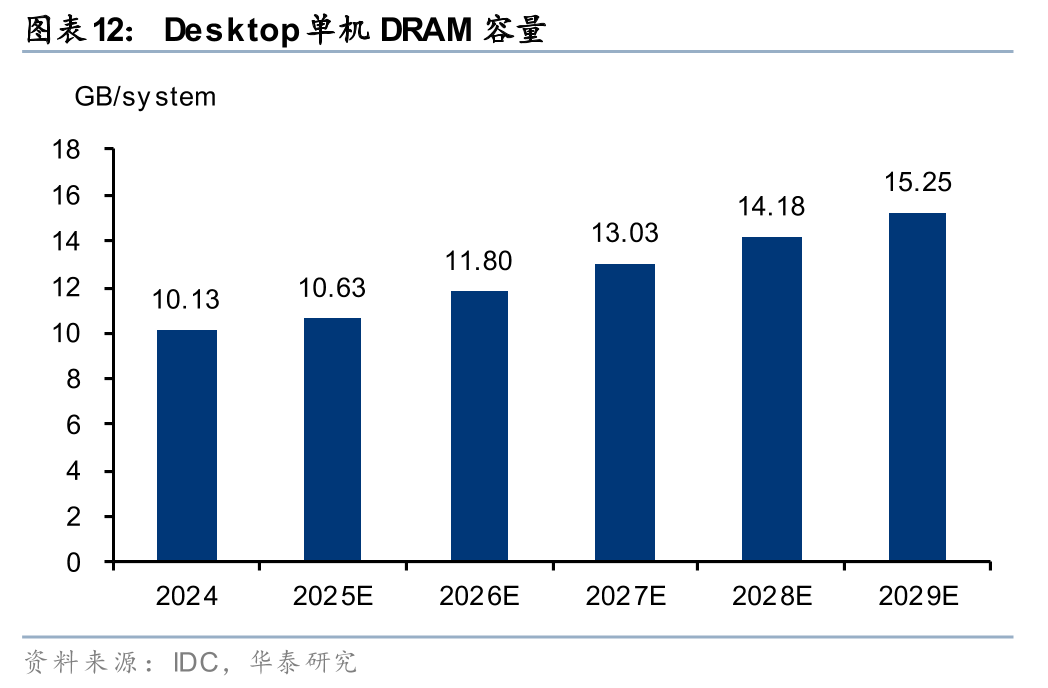

24年PC单机DRAM容量达到10GB,在AI本地部署拉动下,预计29年有望超过15GB。AI模型本地部署对PC存储规格升级需求明确,例如,阿里通义千问7B模型的原始大小是14.4GB,在联想的Lenovo AI now中运行的模型则压缩到了4GB。由此,AI大模型+电脑本身的缓存,大概要5-6GB内存运行,而OS本身需占用5-6GB,故未来运存最低或也需要12/16GB才能保证PC稳定运行。IDC预计,2029年笔记本电脑的单机DRAM容量将从2024年的10GB提升至超15GB,增幅达50%。

AI眼镜:全球销量快速增长,打开新成长空间

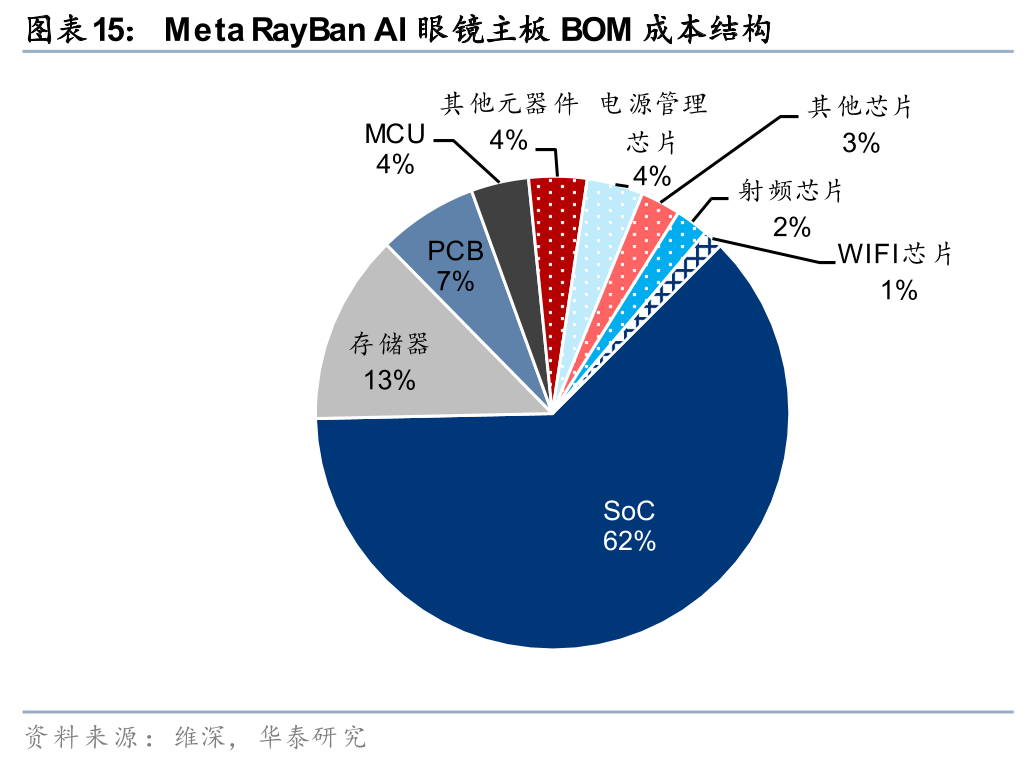

AI眼镜存储在主板BOM成本中占比达10-15%,仅次于主控SoC,2030年有望带来20亿美金新增市场。2024年10月以来,包括百度、回车科技、Rokid、影目、闪极、小米在内的多家公司加入智能眼镜战场。据Wellsenn预测,25年全球AI眼镜出货量有望达到550万台,2030年将进一步增长至9000万台。目前小米、雷鸟、Meta等厂商的AI眼镜存储配置大多采用基于LPDDR4/4X和eMMC5.1合封的ePOP芯片,容量通常为2GB+32GB,存储在主板BOM成本占比约10%-15%(参考Meta RayBan AI眼镜)。随着AI眼镜AI处理能力不断升级,未来存储容量有望升级至4GB内存+64GB闪存。根据我们测算,2025年AI眼镜对应存储市场规模约0.85亿美金,2030年有望超过20亿美金。

风险提示

1) 下游需求复苏不及预期风险;

2) 国产存储供应链技术进展不及预期风险;

3) 地缘政治风险;宏观经济波动风险;

4) 本研报中涉及到的未上市公司或未覆盖个股内容,均系对其客观公开信息的整理,不代表本研究团队对该公司、该股票的推荐或覆盖。

相关研报

研报:《电子: 存储:AI驱动需求增长,周期持续上行》2025年10月12日

谢春生 分析师 S0570519080006 | BQZ938

张皓怡 分析师 S0570522020001

陈钰 分析师 S0570523120001

林文富 分析师 S0570525100003